LLM (Large Language Model), LVM (Language Vision Model), 등의 GM (generative model)이 떠오름에 따라 인공지능이 의사를 대체할 것인가에 대한 이야기가 심심찮게 나옵니다. 많은 사람들이 LLM을 기존의 인공지능 모델과는 다르다고 이야기하고 수많은 어려운 임상 챌린지에서 LLM, LVM, FM (foundational model) 모델들이 의사를 능가한다는 AGI (artificial general intelligence) 시대가 가까워졌다고 하며 의사가 곧 대체될거라는 이야기를 많이들 합니다. 기술의 발전은 놀랍지만 진짜로 LLM, LVM, FM이 의료를 대체할 수 있을지에 대한 대답은 아직 결정난 것이 아니기는 합니다. 이 글에서는 규제적 측면, 법적 책임 측면에서 진정으로 기존, 그리고 새롭게 부상하는 LLM, LVM, FM과 같은 거대모델들이 의사를 대체할 수 있을지 살펴보도록 합니다.

이 글에서는 GM을 FM, LLM과 LVM을 포함하는 단어로 사용합니다.

규제적 측면

미국 FDA의 입장

FDA는 공식적으로 LLM에 대한 인허가 가이드라인을 내놓지 않고 있습니다. 하지만 현재 FDA의 홈페이지를 참고하면 LLM에 대한 가이드라인을 제작 중이라고 하는 것 같고, Aidoc은 자사의 홈페이지를 통해 CARE1이라는 foundation model을 FDA 당국에 제출했다고 이야기하는 것을 보면 미국 내부에서도 규제적 가이드라인을 생성하려는 것과 FM들이 제품화되려는 시도들이 진행되고 있는 것 같습니다.

FDA 홈페이지에서 medical device의 정의를 살펴보면 intended use와 indication을 정의해야 한다고 나와 있습니다. 이는 21st Century Cures Act (Cures Act) 법안의 section 520의 (o)를 참고하면 자세하게 알 수 있는데요, 520(o)는 의료기기(medical device)가 아닌 것에 대한 정의를 내리고 있습니다. 520(o) (원문 링크)를 살펴보면,

- 의료기기(medical device)라는 용어에는 다음 목적을 가진 소프트웨어 기능은 포함되지 않는다.(The term device, as defined in section 201(h) of this title, shall not include a software function that is intended -)

- 의료기관의 행정적 지원을 위한 소프트웨어 기능

- 질병이나 상태의 진단, 치료, 완화, 예방과 관련되지 않고, 건강한 생활습관의 유지 또는 장려를 목적으로 하는 소프트웨어 기능

- 전자 환자기록(electronic patient record; EPR)으로 기능하는 소프트웨어. 단, 다음 요건을 모두 충족해야 한다.

- 이러한 기록은 의료 전문가 또는 그 감독 하의 인력에 의해 생성, 저장, 전송, 검토된 것일 것.

- 해당 기록은 Public Health Service Act §3001(c)(5)의 자발적 인증 프로그램에 따라 인증된 health IT의 일부일 것.

- 해당 소프트웨어 기능은 환자 기록(의료 영상 데이터 포함)을 진단·치료 등을 위한 해석이나 분석 목적으로 사용하도록 의도되지 않을 것

- 임상 검사(예: clinical laboratory test) 또는 기타 의료기기 데이터 및 결과의 전송, 저장, 형식 변환 또는 표시 기능, 또는 의료 전문가에 의해 작성된 소견, 일반적인 정보, 해당 검사나 기기에 대한 배경 정보 등을 표시하는 기능. 단, 해당 기능이 검사 데이터·결과·소견을 해석하거나 분석하도록 의도된 경우는 제외

- 다음 목적을 위해 의료 영상, 체외진단 장비에서 나오는 신호, 또는 기타 신호 획득 시스템에서 나온 패턴/신호를 취득·처리·분석하도록 의도되지 않은 소프트웨어 기능:

- 환자 또는 기타 의료정보(예: peer-reviewed 임상 연구, 임상 가이드라인)의 표시, 분석, 출력

- 질병 또는 상태의 예방·진단·치료에 관한 의료 전문가 대상 추천 또는 지원 제공

- 의료 전문인이 해당 소프트웨어가 제시하는 추천의 근거를 독립적으로 검토할 수 있도록 하여, 특정 환자에 대한 임상 진단 또는 치료 결정을 내릴 때 해당 추천에 주로 의존하도록 의도되지 않을 것

- 하나의 제품이 위 (1)에 해당하는 비-의료기기 기능과 의료기기 기능을 함께 포함하는 경우, 그 제품은 장관(Secretary)이 적절하다고 판단하는 범위 내에서 본 장의 규제를 받는다.

- (1)의 (iii), (iv), (v)에 해당하는 소프트웨어 기능이라도, 장관이 다음을 판단하는 경우에는 의료기기 정의에서 제외되지 않는다.

- 해당 기능이 심각한 부작용을 유발할 가능성이 “상당히 높다”는 합리적 근거가 있을 경우

- 장관이 적절하다고 판단하는 추가 실체적, 절차적 기준을 충족할 경우

- 본 항은 사람의 질병 예방을 돕기 위한 혈액 및 혈액 성분의 제조·수혈에 사용되는 소프트웨어 기능을 규제할 수 있는 장관의 권한을 제한하는 것으로 해석되어서는 안 된다.

- 또한 장관은 (1)(i)–(v)에 언급된 소프트웨어 기능이 의료기기에 해당하는지 여부를 결정할 수 있다.

- (i)의 결정에 따르며, §201(h)의 “의료기기” 정의에는 (1)(i), (ii), (iii), (iv)에 해당하는 소프트웨어 기능은 포함되지 않는다.

쉽게 말해서, 상식적으로 의료기기가 아니라 의료행위의 전자화를 위한 소프트웨어 및 추상적인 의미에서 헬스케어 제품들은 의료기기로 분류되지 않는다는 것을 알 수 있습니다.

의료기기가 아닌 제품들의 요건을 살펴 보았으니, 의료기기가 갖춰야 하는 요건들 또한 살펴볼 필요가 있습니다. 520(o)에 달린 링크를 타고 들어가 (h)를 살펴보면,

- “의료기기(device)”라는 용어는 (본 절의 (n)항 및 본 제목의 331(i), 343(f), 352(c), 362(c) 조항에서 사용된 경우를 제외하고) 다음에 해당하는 어떤 기구, 장치, 기기, 기계, 장치물, 인체 내 시약(in vitro reagent), 또는 그와 유사하거나 관련된 물품을 의미하며, 이에는 그 구성품, 부품, 또는 액세서리가 포함된다. 즉—

- 공식 National Formulary 또는 United States Pharmacopeia(미국 약전) 또는 그 부속 문서에 등재된 것, 또는

- 인간 또는 다른 동물의 질병 또는 기타 상태의 진단, 또는 질병의 치료, 완화, 처치, 예방을 위해 사용하도록 의도된 것, 또는

- 인간 또는 다른 동물의 신체 구조 또는 기능에 영향을 미치도록 의도된 것이며, 또한 다음 조건을 충족하는 것 - 해당 제품은 그 일차적 의도된 목적(primary intended purposes) 을 달성하기 위해 인간 또는 동물의 신체 내에서 화학적 작용(chemical action) 을 통해 작동하지 않으며, 그 일차적 목적 달성을 위해 대사(metabolized) 되는 것에 의존하지 않는다. 그리고 “의료기기(device)”라는 용어에는 본 제목의 §360j(o) 에 따라 의료기기에서 제외된 소프트웨어 기능은 포함되지 않는다.

- “위조 의료기기(counterfeit device)”라는 용어는 다음에 해당하는 의료기기를 의미한다. 즉, 정당한 권한 없이, 그 기기 자체 또는 그 용기·포장·라벨이 상표(trademark), 상품명(trade name), 기타 식별 표시나 각인, 또는 그와 유사한 표시를 사용했거나, 또는 해당 의료기기를 실제로 제조·가공·포장·유통한 자가 아닌 다른 의료기기 제조업자, 가공업자, 포장업자 또는 유통업자의 설계를 사용하여 제조된 경우를 말한다. 그리고 그러한 방식으로 인해, 해당 의료기기는 실제 제조·가공·포장·유통한 자가 아닌 다른 업체의 제품인 것처럼 허위로 주장되거나 그렇게 표시·표현된 기기를 말한다.

이렇게만 살펴보면 FM 또한 의료기기에 포함될 가능성이 애매해 보입니다. 구체적으로는,

- LLM을 포함한 FM들은 520(o)의 요건에 걸리지 않으며(즉, 의료기기가 아니라는 근거가 없으며),

- 위 (h)에서의 (1)(ii)를 참고하면, 인간 또는 다른 동물의 질병 또는 기타 상태의 진단을 위해 사용되도록 의도된 것은 아닐수도(ex: ChatGPT) 맞을수도(ex: Medical에 특화된 LLM) 있기 때문에 일획적으로 의료기기라고 할 수도 없고 의료기기가 아니라고 할 수도 없습니다.

FDA 홈페이지에서 제품 코드를 살펴보면 아직 FM이나 LLM, LVM에 대한 제품 코드는 존재하지 않는 것을 알 수 있습니다(어떤 키워드로 검색해봐도 제 수준 하에서는 나오지 않는 것 같습니다.).

한국 식약처의 입장

2025년 1월 24일 한국 식약처에서는 생성형 인공지능 기기의 의료에서의 허가와 심사에 대한 가이드라인을 출간하였습니다. 주의할 점은, 혁신적 의료기기의 요양급여 여부 평가 가이드라인과는 다르게 본 글은 생성형 의료인공지능 기기의 보상(reimbursement)에 관한 글이 아니라 인허가에 관한 가이드라인 문서라는 것입니다. 즉, 수가를 받기 위한 최소 조건인 인허가를 다루는 문서이지 실제로 어떻게 해야 수가를 받는지에 관한 글이 아닙니다.

FM은 일반적인 supervised 의료인공지능 기기와는 다릅니다. 기존의 의료인공지능 기기는 거의 supervised learning을 통해서 한 두개의 적응증에 대해 검증을 했어도 되었음에 비해, FMl은 거대한 데이터셋 매칭을 통해 CXR에서 판독문을 생성하는 등과 같이 몇 가지 이상의 modality에 대해 전반적인 기능을 제공합니다. 따라서 더욱이 검증이 harsh 해질 수밖에 없고 dataset의 bias (머신러닝 용어로는 aleatoric uncertainty가 가깝겠습니다)와 model의 bias (머신러닝 용어로는 episemic uncertainty를 포함하는 개념들이 가깝겠습니다.)에 모두 영향을 받습니다. 또한 같은 입력값에 대해서도 다른 결과를 낼 수 있는 undeterministic property에 의해서 반복적인 검증이 필요합니다.

또한 아무리 logical thinking이 가능하다고 해도(i.e. ChatGPT) 그 내부의 logic을 샅샅히 파헤쳐 볼 수는 없으므로 explainability에 한계가 있게 됩니다.

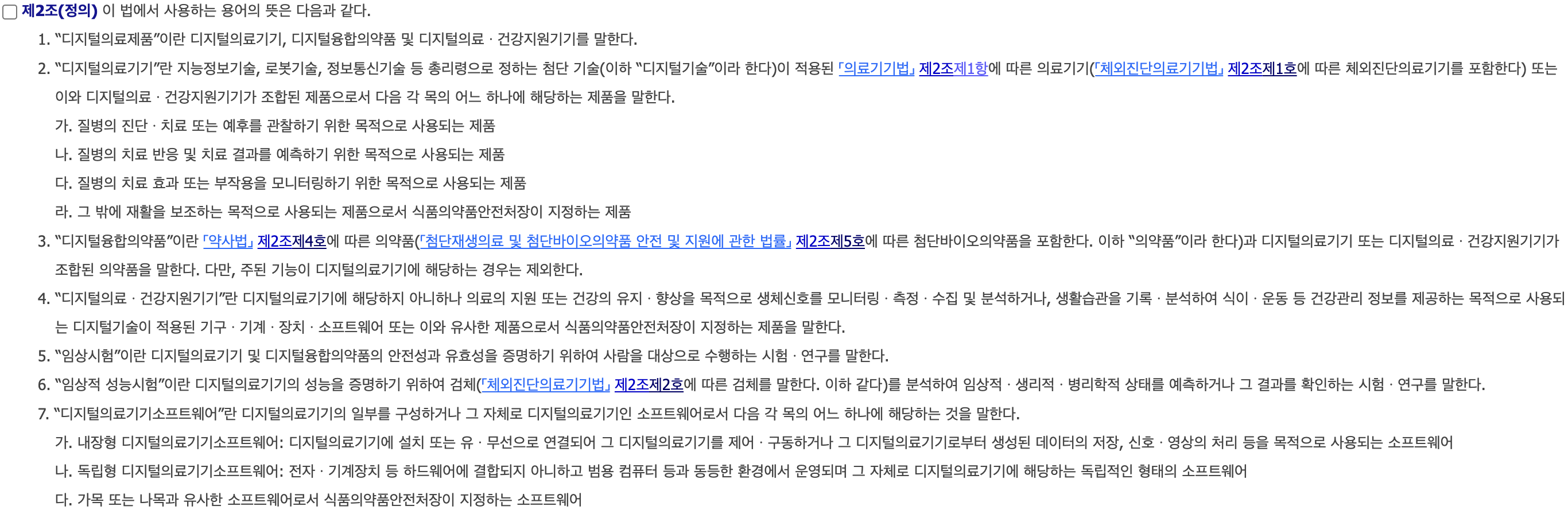

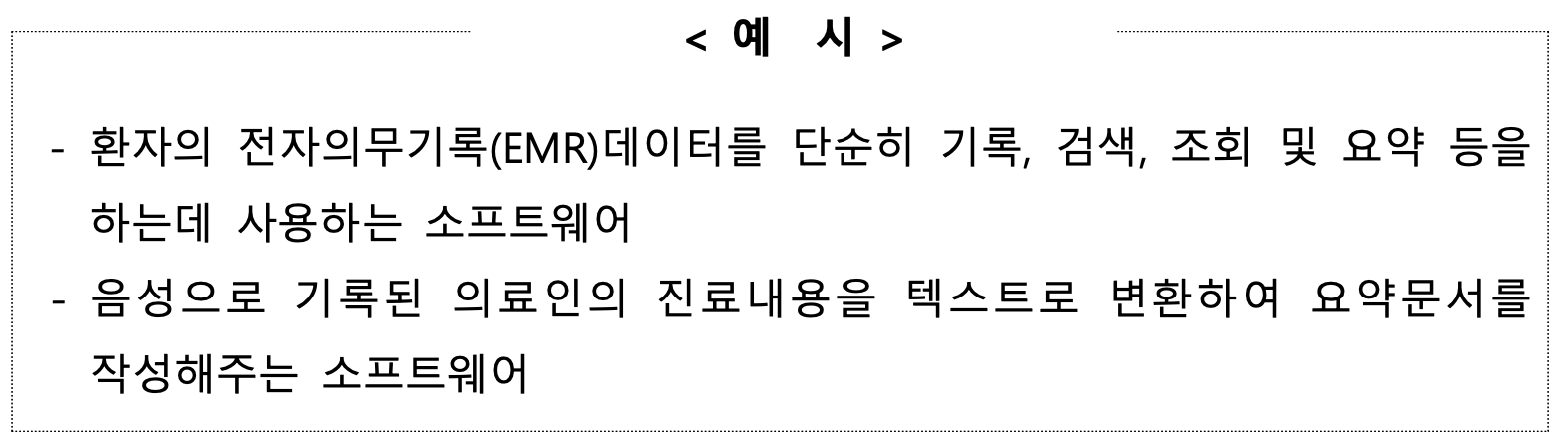

본 가이드라인은 이러한 문제점으로부터 시작하게 됩니다. 본 가이드라인은 [디지털의료제품법] 2조(특히 2조 2항)인 다음에 따라

디지털의료기기 중 질병의 진단, 치료, 또는 예후를 예측하기 위한 목적으로 환자에게 적용되는 모델들 중에서 foundation model을 활용한 의료용 어플리케이션과 의료용 파운데이션 모델을 활용한 어플리케이션에 한정됩니다.

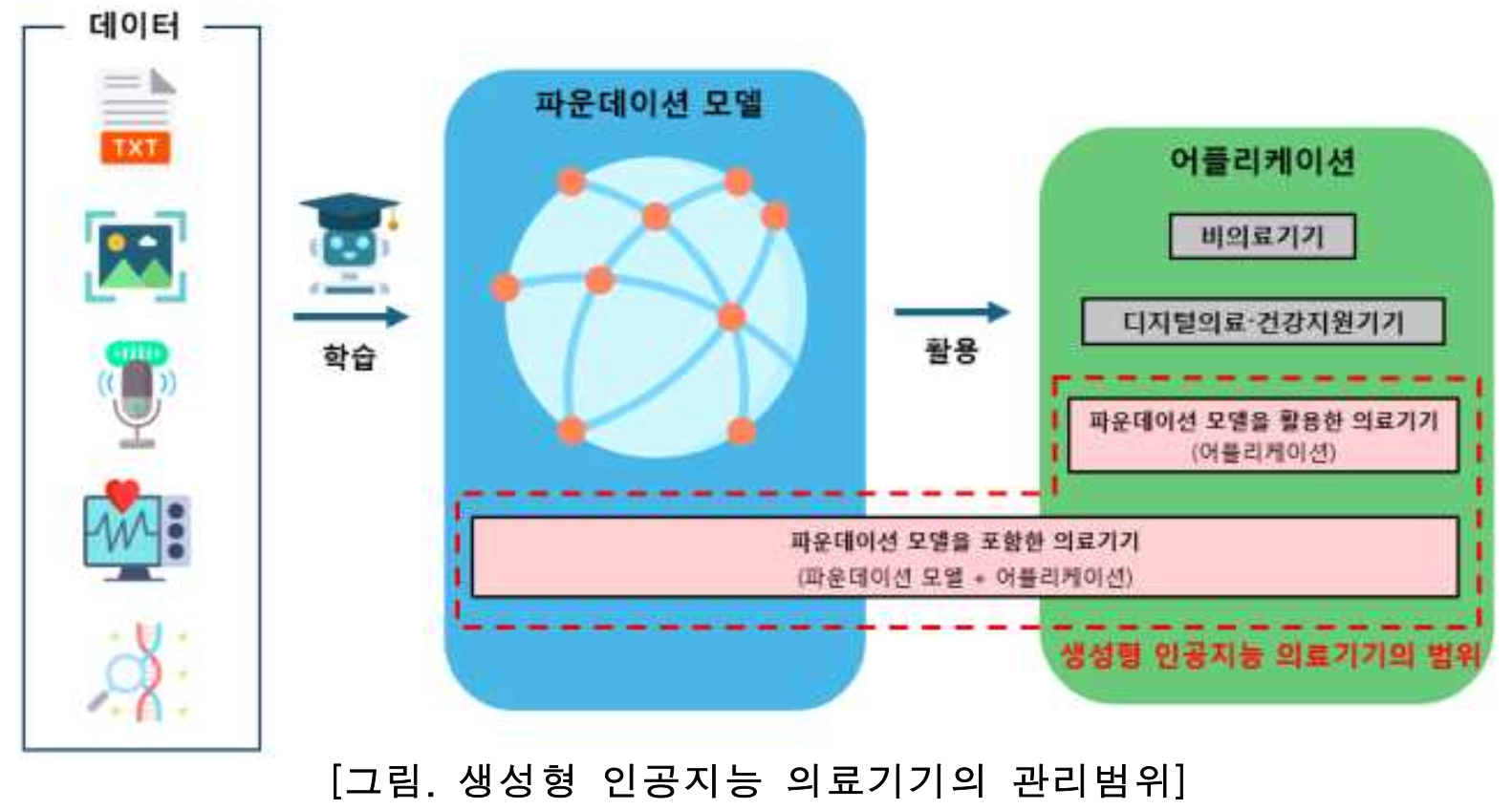

쉽게 말해서, 위 그림의 빨간 박스인 파운데이션 모델을 활용하거나 포함한 의료기기만을 대상으로 합니다. 또한 물론, 의료법과 개인정보보호법 등 타 법령이 준수되어야 합니다. 생성형 인공지능 의료기기인 예는 다음과 같습니다.

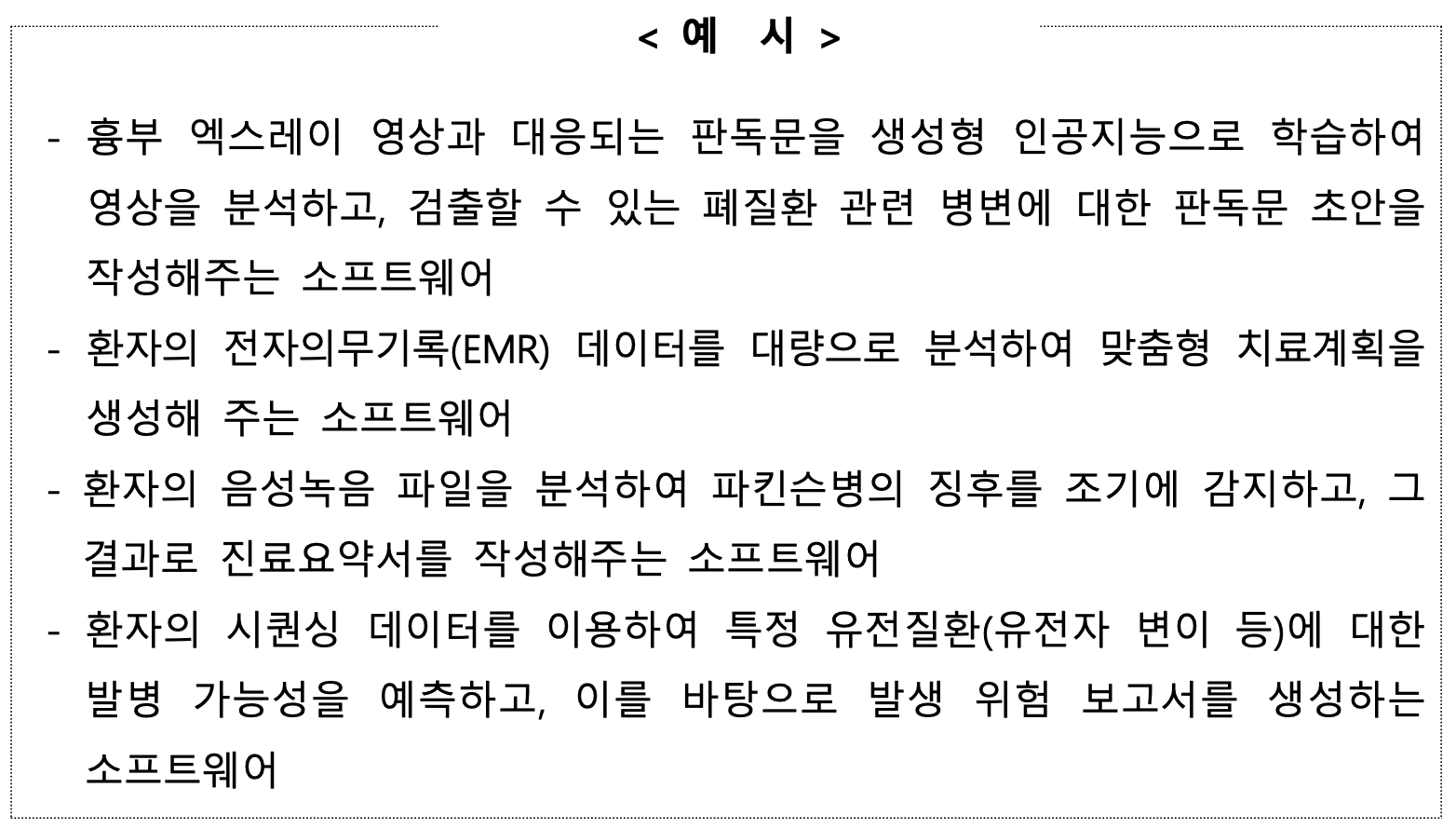

생성형 인공지능 의료기기가 아닌 예시는 다음과 같습니다.

결국 다른 말로 하면 [디지털의료기기법]에서 정의한 의료기기의 범주 내에 있는지 여부만 잘 살펴보면 됩니다.

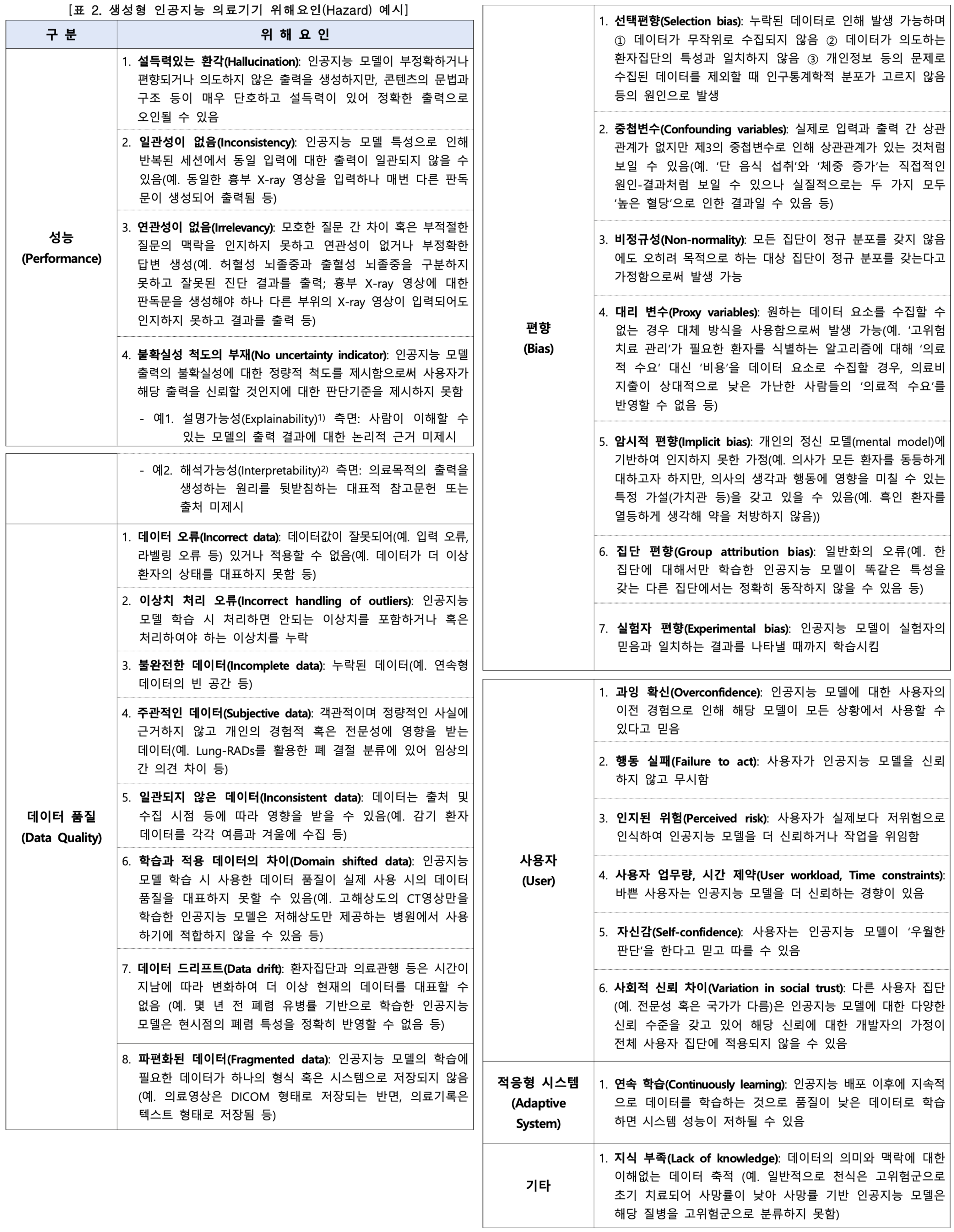

위험관리에 있어서는 가이드라인을 참조하면, 생성형 인공지능 의료기기에서 발생할 수 있는 위험들은 무려 네 페이지에 걸쳐서 다음과 같이 상술되어 있습니다.

한 번 쭉 읽어보면 어렵지 않게 이해가 됩니다. 쉽게 말해서, 상상 가능한 모든 위험을 기술했다고 생각하시면 됩니다.

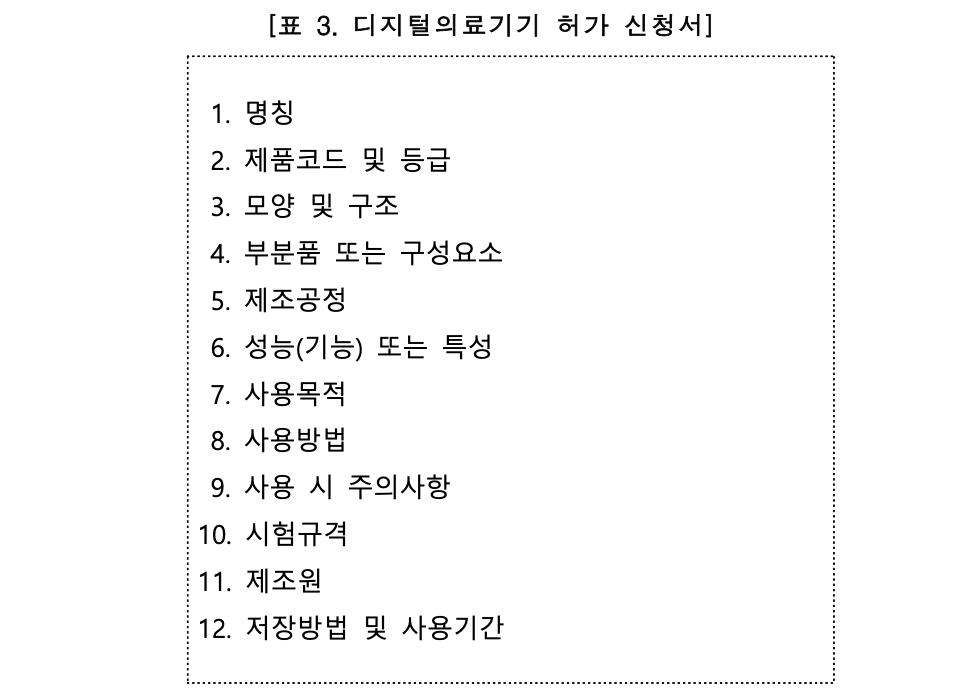

허가와 심사는 일반적인 의료기기의 항목과 크게 다르지 않습니다.

다만 조금 바뀌는 부분 중 첫 번째는 [성능(기능) 또는 특성]에서 임상적 지표 뿐 아니라 머신러닝 지표도 포함하여 평가를 수행하겠다는 부분인데요, 이는 파운데이션 모델이 단순히 임상적 지표인 민감도, 특이도, AUROC를 포함함을 넘어 자연어 작성(판독문 생성)과 같은 부분을 담당하기 때문에 머신러닝 지표인 RADPEER, Bert Score, etc를 포함할 수밖에 없는 불가피성을 함의하는 것으로 보입니다.

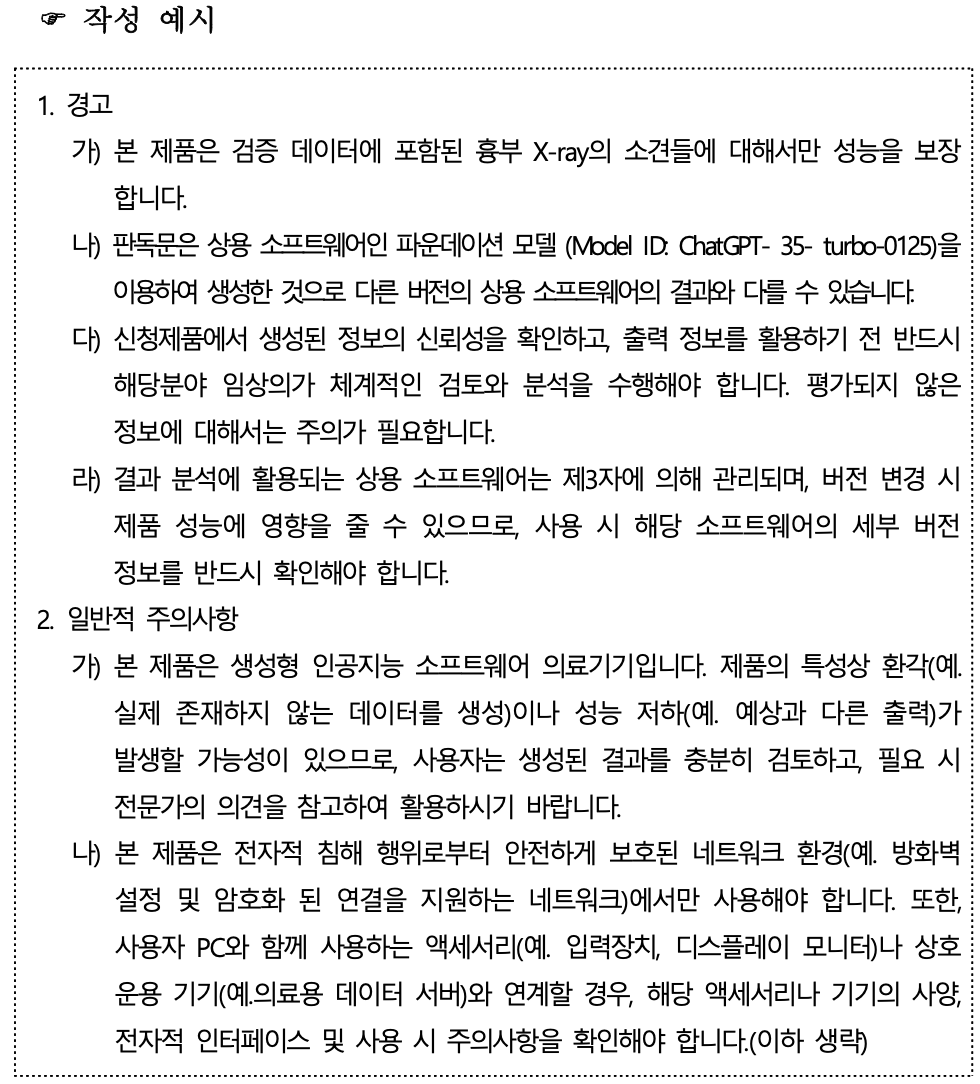

두 번째는 사용시 주의사항입니다. 이 부분은 살짝 추상적으로 기술되어 있습니다. 요는, 학습 데이터와 임상시험을 통해서 증명한 use-case scenario 이외에서는 주의를 요하라는 것이 골자입니다. 결국 limited environment으로 검증한 것을 real-world에 너무 과대적용하지 말라는 것으로 이해할 수 있겠습니다.

작성 예시를 살펴보면 이해가 쉽습니다

- 경고의 가) 항목은 데이터셋에 대한 제한적 환경으로 검증되었음을 경고하고 있고 나) 항목은 모델에 대한 제한적 환경으로 검증되었음을 경고하고 있습니다.

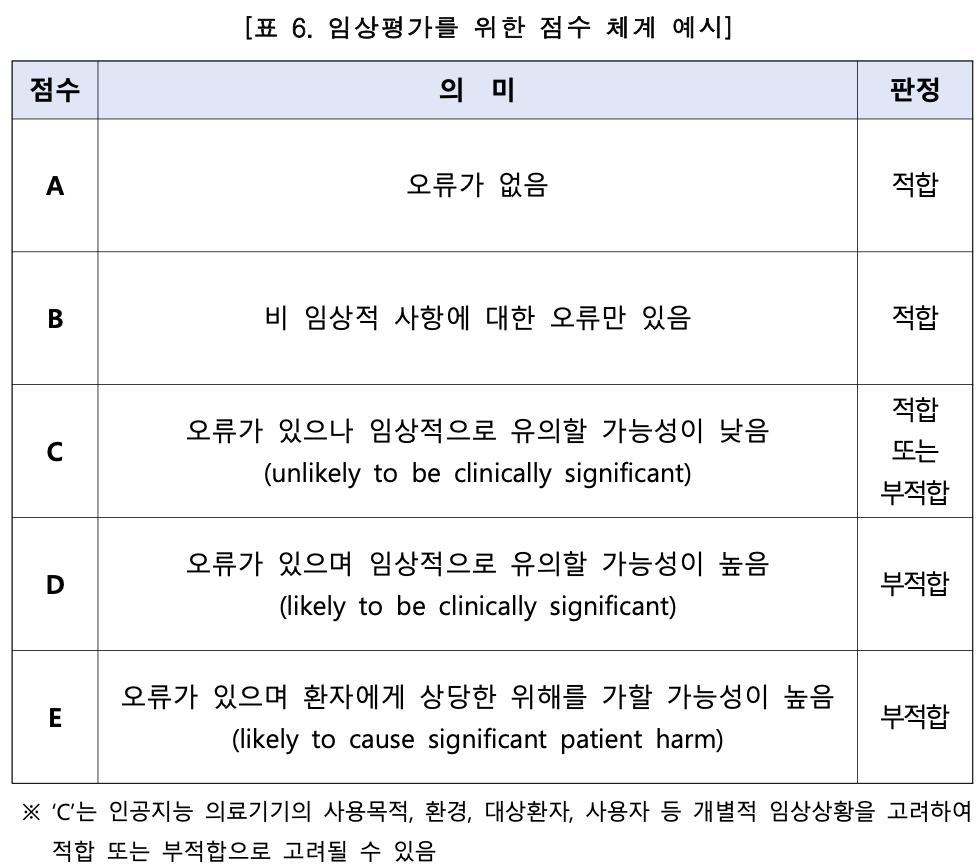

임상적 검증에 있어서는 기존의 의료기기에 비해서 불가피하게 주관성을 더 넓게 인정해주는 것으로 사료됩니다:

결론적으로, 큰 틀에서는 기존 의료기기의 인허가 방식과 바뀌지는 않았지만, 다음 세 지점에서 변화가 있었다고 생각할 수 있습니다.

- 임상적 지표(민감도, 특이도, AUROC)를 벗어난 머신러닝적 지표들에 대한 인정

- 더 넓고 추상적인 범위의 사용 시 주의사항에 대한 기술.

- 임상 평가에 대한 주관성의 부분적 인정

한 마디로 요약하자면, 인허가가 더 어려워졌다고 보기는 힘들 것 지만 오히려 더 조심스럽고 일반론적으로 검증을 요구하게 변한 것으로 생각됩니다.

법적 책임 소재 측면

NEJM Catalyst에 올라온 본 글을 참고하면, 이 글은 AI의 임상적 도입을 늦추는 큰 원인 중 하나가 법적 책임 소재라고 합니다. 즉, AI가 잘못 진단/추천을 하면 누가 책임질 것인가?에 대한 대답을 의사, 병원, 알고리즘 개발자, 제조사 등으로 나눠서 정해야 하는데 이에 대한 책임 소재가 불분명하다는 것이지요. 또한, AI는 인간과는 다르게 실수를 반복하는, 동일한 오류가 대규모로 반복될 수 있는(error의 scalability) 위험이 있어 기존 의료 과실(malpractice)과는 다르다고 합니다.

본 글에서는, AI 책임보험이 의료 AI 도입을 가속화할 것이라고 주장하는데, 구체적으로 이러한 AI 보험은

- 법적 위험에 대한 보호: 개발자, 의사, 병원의 책임 리스크를 줄이고

- 고품질 AI에 대한 선택 유도: 보험사는 안전하고 증거 기반의 AI를 선택할 것이기 때문에 고품질 AI에 대한 품질이 향상될 것이라고 주장합니다.

- 규제기관과 보험사의 합동 인증(credentialing)을 촉구: 검증 과정에서의 안전성과 성능 데이터를 보험사가 요구하고, 실사용 성능을 모니터링(real-world monitoring)하므로 안전한 AI 생태계 조성이 가능하다고 하며

- 작은 병원, 클리닉의 인공지능 도입 장벽 완화: 제조사가 보험을 끼워 판매할 수 있기 때문에 작은, 소규모의 병원 또한 AI 도입이 쉽고 안전하다고 주장합니다.

즉, 오류 확률이 측정 가능하고 예측 가능하며, 설명 가능성, 해석 가능성이 있고, 증거 기반의 의료 지침과 일치하고, 대규모 시스템 오류 가능성이 낮고, 사이버 보안 위험이 낮은 인공지능이 보험의 대상이 되기가 쉽다고 합니다.

이에 대입해보면,

- 오류 확률이 측정 가능한가? FM, 특히 LLM의 비결정론적(indeterministic) 응답은 오류 확률이 측정 가능하지 않습니다.

- 설명 가능성, 해석 가능성이 높은가? LLM은 기존의 AI 모델들에 비해서 논리적으로 응답하는 능력이 크게 향상되었기 때문에 설명 가능성 및 해석 가능성이 높다고 할 수 있습니다.

- 증거 기반 의료 지침과 일치하는가? LLM은 의료 지침(guideline)에 대입하여 응답을 만들어낼 수 있기때문에 가이드라인과 일치하지는 않지만, 가이드라인에 기반하여 응답을 만들어 낼 수 있습니다.

- 대규모 시스템 오류 확률이 낮은가? 사용자가 LLM의 응답을 부정하고 [아니야, 다시 생각해 봐]라고 했을 때를 비롯하여 대규모로 응답이 잘못될 가능성도 있기 때문에 오류 확률은 높다고 할 수 있습니다.

결론적으로, 본 글의 논점을 따라가다 보면 LLM에 대한 의료 인공지능 책임 보험은 디자인하기가 매우 까다로워 보입니다. 하지만 실제 클리닉과 병원에서 LLM에 대한 의존성이 높아지는 것을 보면 해당 글의 논점을 100% 현실적이라고 할 수는 없겠네요.

결론

제가 이전에 Collingridge 딜레마를 언급한 적이 있습니다. 신기술의 발전 초기에는 기술의 영향을 쉽게 바꿀 수 있지만 영향이 불확실하고, 기술이 널리 확산되고 문제가 명확해질 때는 이미 통제·변경하기가 매우 어렵다는 구조적 역설을 말하는 것이지요.

항상 그래왔듯, 기술의 발전보다 제도의 따라감이 늦으니 차분히 기다리면 LLM도 어느날엔가 의료기기로 인정받는 날이 올 것이라고 믿습니다. 하지만 규제와 법적 책임 관점에서 LLM이 자율적 인공지능(autonomous AI; 스스로 검사를 판독하고 이후 치료와 관리까지 매니지하는 인공지능을 일컫는 FDA 용어)로 인정받기는 쉽지 않아 보입니다. 이는 단순히 인공지능에 대한 반발이 절대로 아니며, 이전 시대의 법과 정책 입안자들이 이런 시대가 올 것을 예상하지 못했던 것이 더 큰 이유인것 같습니다. 따라서 FM들이 의사를 대체하는 날은 빠른 시일 내에는 오지 않을 것으로 보입니다. 하지만 미래는 모르기 때문에, 완전대체라는 그 날이 올 때까지 우리가 해야 할 일은 좋은 모델을 개발하여 최소한의 부작용으로 최대한의 임상적 유용성을 만들어내는 것이 아닐까 합니다.